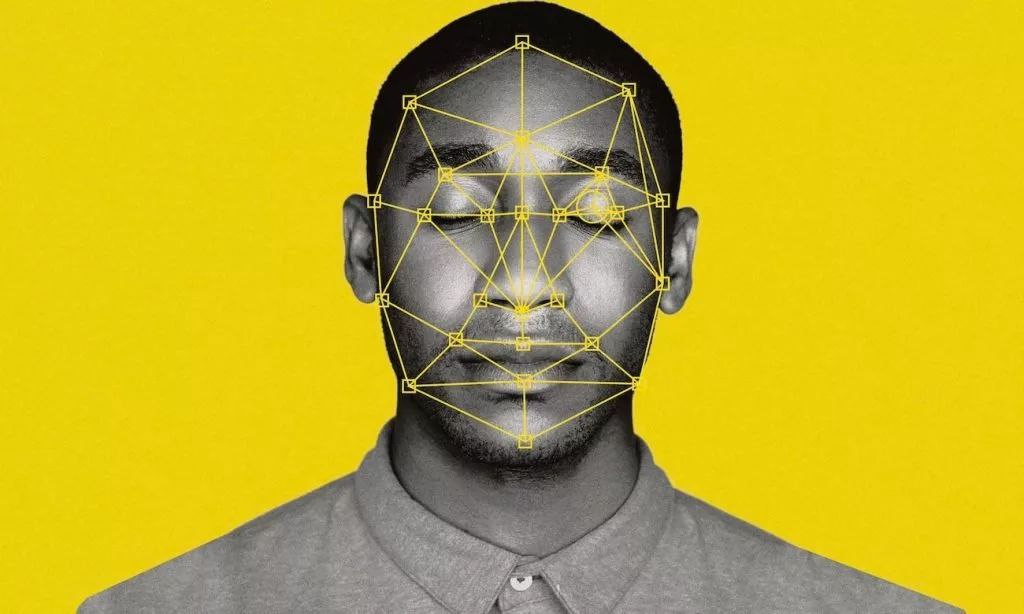

هوش مصنوعی در سالهای اخیر به شکلی شتابزده وارد زندگی حرفهای افراد شده و حالا از رزومهنویسی و مدیریت فرایندهای استخدامی بسیار فراتر رفته است. جدیدترین گزارش منتشر شده از سوی دانشگاه پنسیلوانیا، موج تازهای از بحثهای اخلاقی و نگرانیهای اجتماعی را ایجاد کرده؛ گزارشی که ادعا میکند AI میتواند تنها با تحلیل چهره، ویژگیهای شخصیتی، مهارتهای نرم و حتی احتمال موفقیت شغلی افراد را پیشبینی کند.

ایدهای که برای برخی جذاب و هیجانانگیز است، اما برای بسیاری دیگر کابوس آینده استخدام محسوب میشود.

این پژوهش دقیقاً چه میگوید؟

محققان دانشگاه پنسیلوانیا در تازهترین پژوهش خود، از تصاویر ۹۶ هزار فارغالتحصیل MBA در لینکدین استفاده کردهاند. هدف آنها این بود که بررسی کنند آیا حالت چهره، تقارن صورت، تنش عضلانی و سایر ویژگیهای بصری میتوانند معیارهایی برای تشخیص ویژگیهای شخصیتی باشند یا خیر.

این تیم پژوهشی، پنج ویژگی اصلی شخصیت انسان که در روانشناسی با عنوان «Big Five» شناخته میشود را ملاک سنجش قرار داد:

-

گشودگی (Openness)

-

وظیفهشناسی (Conscientiousness)

-

برونگرایی (Extraversion)

-

توافقپذیری (Agreeableness)

-

روانرنجوری (Neuroticism)

نتایج اولیه پژوهش نشان میدهد که مدلهای هوش مصنوعی توانستهاند الگوهای تکرارشوندهای میان حالت چهره، فرم قرارگیری سر و نحوه ثبت عکس با این ویژگیهای شخصیتی پیدا کنند.

به زبان سادهتر:

هوش مصنوعی مدعی است که از روی چهره، میتواند حدس بزند آدمها چقدر برونگرا هستند، چهقدر وظیفهشناساند یا احتمالاً چقدر ممکن است تحت فشار روانی قرار گیرند.

هوش مصنوعی چگونه این تحلیل را انجام میدهد؟

این مدلها از تکنیکهای پیشرفته بینایی ماشین (Computer Vision) و شبکههای عصبی عمیق (Deep Learning) استفاده میکنند.

اطلاعاتی که از چهره استخراج میشود شامل:

● تقارن صورت

افرادی با تقارن بیشتر معمولاً در روانشناسی کلاسیک، جذابتر و قابلاعتمادتر تلقی شدهاند. AI نیز همین الگوها را تکرار میکند.

● میکرو اکسپرشنها

مثل بالا رفتن ناخواسته ابرو، نیملبخندهای کوتاه و جمع شدن چشمها که هرکدام سیگنالهایی احساسی یا شخصیتی دارند.

● زاویه سر و نحوه ژست گرفتن

این مورد در بسیاری از مدلهای پیشبینی شغلی دیده میشود. افراد برونگرا معمولاً سر را کمی بالا میگیرند یا لبخند بزرگتری دارند.

● کیفیت عکس

نورپردازی، پسزمینه و نوع دوربین میتواند برداشت AI از شخصیت را تغییر دهد—موضوعی که خود یک چالش بزرگ اخلاقی است.

نتایج این پژوهش چه معنایی دارد؟

۱. شتاب گرفتن اتوماسیون در مصاحبههای کاری

استفاده از AI برای غربال اولیه رزومهها چیز جدیدی نیست؛ اما اینکه چهره افراد معیار انتخاب یا حذف شود، مرحلهای بحثبرانگیزتر و پیچیدهتر است.

شرکتها ممکن است در آینده از این ابزار برای:

-

تشخیص میزان مناسب بودن فرد برای نقشهای مدیریتی

-

پیشبینی ریسکهای رفتاری

-

شناسایی شخصیتهای سازگار با فرهنگ سازمان

استفاده کنند.

۲. تقویت تعصبات پنهان (Bias)

یکی از ترسناکترین پیامدها این است که مدلهای هوش مصنوعی ممکن است تعصبات نژادی، جنسیتی یا فرهنگی موجود در دادهها را بازتولید کنند.

اگر ۹۶ هزار تصویر استفادهشده، بیشتر متعلق به افراد سفیدپوست یا از یک منطقه خاص باشد، نتیجهها ناخواسته جانبدارانه خواهد بود.

۳. کاهش اهمیت مصاحبههای انسانی

با گسترش این ابزارها، شرکتها شاید تصمیم بگیرند که مرحله اول مصاحبه را کاملاً به هوش مصنوعی بسپارند. این موضوع میتواند باعث شود افراد بر اساس ظاهر فقط در یک عکس ارزیابی شوند؛ نه بر اساس توانایی واقعی.

۴. تغییر استانداردهای کاری و اجتماعی

اگر شرکتها به چنین مدلهایی اعتماد کنند، ممکن است جامعه به سمت استانداردهای ظاهری جدیدی برود؛ مثل:

-

“ژیست مناسب برای لینکدین”

-

“لبخند شغلی”

-

“چهره قابل استخدام”

این موضوع میتواند فشار روانی مضاعفی بر افراد وارد کند.

هوش مصنوعی چقدر قابل اعتماد است؟

بسیاری از متخصصان علوم شناختی و روانشناسی نسبت به نتایج این پژوهش تردید دارند.

استدلال آنها چیست؟

■ ویژگیهای شخصیتی پایدار نیستند

افراد در شرایط مختلف واکنشهای متفاوتی نشان میدهند. یک عکس لحظهای نمیتواند شخصیت واقعی فرد را نشان دهد.

■ چهره نمیتواند تعیینکننده شخصیت باشد

این پیشفرض ریشه در نظریههای ردشده فیزیوژنومی (شخصیتشناسی بر اساس چهره) دارد که از نظر علمی اعتبار ندارد.

■ مدلهای AI همیشه شفاف نیستند

این مدلها میتوانند الگوهایی را پیدا کنند که برای انسانها قابل درک نیست؛ حتی اگر کاملاً بیربط باشند.

آیا شرکتها قرار است از این فناوری استفاده کنند؟

برخی شرکتها از همین حالا در حال آزمایش سیستمهای تشخیص احساسات در مصاحبههای ویدیویی هستند؛ ابزاری که چهره را تجزیهوتحلیل میکند و درباره اعتمادبهنفس، انرژی و هماهنگی رفتاری فرد امتیاز میدهد.

اگر نتایج پژوهش دانشگاه پنسیلوانیا گسترش پیدا کند، پیشبینی میشود:

-

پلتفرمهای کاری مثل لینکدین

-

شرکتهای استخدامی

-

و HR های مبتنی بر هوش مصنوعی

به سمت تحلیل چهره برای پیشبینی موفقیت شغلی حرکت کنند.

پیامدهای اخلاقی و حقوقی

● نقض حریم شخصی

تصویر صورت یکی از حساسترین دادههاست. استفاده از آن بدون رضایت صریح افراد میتواند تهدیدکننده حریم خصوصی باشد.

● احتمال ردشدن افراد بهدلیل ظاهر

ممکن است فردی بهدلیل چهره خسته، نورپردازی بد یا حتی حالت ثابت صورتش از فرصت شغلی محروم شود.

● ایجاد نابرابری شغلی

افرادی با اضطراب اجتماعی، معلولیتهای چهره، بیماریهای پوستی یا اختلالات عصبی ممکن است ناعادلانه مورد قضاوت قرار گیرند.

آینده این فناوری؛ امید یا تهدید؟

پژوهش جدید پنسیلوانیا به ما هشدار میدهد که مرز بین «کمک به استخدام» و «تبعیض الگوریتمی» بسیار باریک است.

اما این فناوری یک روی خوب هم دارد:

-

میتواند زمان غربالگری شغلی را کاهش دهد

-

میتواند خطای انسانی را کم کند

-

میتواند در تشخیص کلاهبرداران یا رفتارهای پرریسک مفید باشد

با این حال، آینده این فناوری به چگونگی قوانین و استانداردهای جهانی بستگی دارد.

اگر مقررات سختگیرانهای برای استفاده از این مدلها وضع نشود، ممکن است به نقطهای برسیم که چهره افراد، مسیر شغلیشان را رقم بزند—نه استعداد و تلاش.

جمعبندی

هوش مصنوعی با سرعتی بیسابقه در حال ورود به فرایندهای استخدامی است و پژوهش دانشگاه پنسیلوانیا تنها یکی از نشانههای این تحول بزرگ است. ایده اینکه یک مدل بتواند شخصیت فرد را از روی چهره تشخیص دهد، هم جذاب است و هم هراسانگیز.

اگرچه این فناوری هنوز اولیه و بحثبرانگیز است، اما هشدار مهمی را منتقل میکند:

آینده مصاحبه کاری ممکن است کمتر انسانی و بیشتر الگوریتمی باشد.

برای حفظ عدالت، شفافیت و کرامت انسانی، ضروری است که شرکتها، دولتها و جامعه علمی با دقت مسیر استفاده از این ابزارها را مشخص کنند.